En 2023 publiqué una pieza titulada "¿Cómo puede el diseño de interfaces orientadas a UX para potenciar el uso de la Inteligencia Artificial acelerar la productividad empresarial y/o educativa?" Estaba explorando una pregunta que parecía prematura y urgente: ¿podría una mejor experiencia de usuario hacer que la IA no sólo sea más utilizable, sino más educativa?

En aquel entonces, la evidencia era principalmente anecdótica. Estudiantes usando ChatGPT para prepararse para los exámenes. Desarrolladores experimentando con IA para la incorporación o la revisión de conceptos. Profesores prototipando planes de clase con ingeniería de indicaciones. Sentía que algo estaba sucediendo bajo la superficie, pero la ciencia no se había puesto al día.

Dos años después, los datos han madurado. Las interfaces han evolucionado. Y las preguntas que nos planteábamos en 2023 ya tienen respuestas tempranas, pero convincentes.

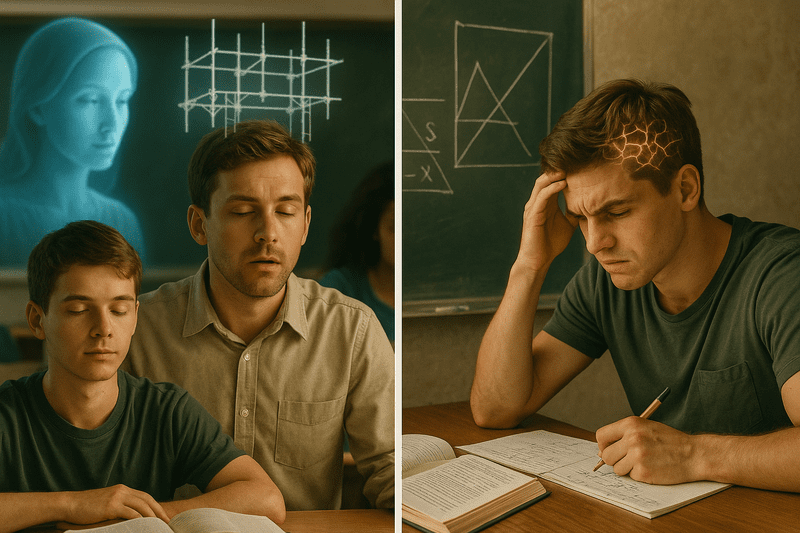

Esto no es solo una reflexión sobre las herramientas de IA. Es un intento de comprender lo que revelan sobre nosotros: cómo aprendemos, qué nos asusta y qué decisiones tomamos cuando la cognición se vuelve colaborativa.

El auge de los tutores de IA ofrece un espejo poco común: no del futuro de la educación, sino de la maquinaria misma del aprendizaje.

Comencemos por donde suele empezar la conversación: la personalización.

El elogio más inmediato para la IA en la educación es también el más obvio: su capacidad para adaptar el contenido al alumno. A diferencia de las aulas tradicionales, limitadas a un ritmo lineal y currículos generales, los tutores de IA se adaptan en tiempo real. ¿Tienes problemas con la estequiometría? El modelo simplifica. ¿Avanzando en el álgebra lineal? Aumenta la dificultad. Es una fantasía pedagógica hecha realidad: instrucción en tiempo real, paciencia infinita, sin juicios.

Pero lo que hace que esto sea más que un simple perfeccionamiento de la experiencia de usuario (UX) es la neurociencia emergente. Estudios actuales demuestran que la creatividad y la comprensión humanas efectivas están estrechamente vinculadas al pensamiento divergente, la flexibilidad cognitiva y la reconfiguración neuronal espontánea, patrones que los sistemas de IA, si bien no replican, parecen excepcionalmente aptos para soportar. No porque piensen como nosotros, sino porque pueden servirnos de andamiaje.

Esta es la distinción fundamental: la IA como espejo de la metacognición, no como sustituto. Un buen tutor no solo da respuestas. Estructura tu confusión. Y en eso coinciden estudiantes de Reddit, profesores de Duolingo y estudios experimentales en Harvard: la IA, bien enmarcada, te enseña a aprender, no solo qué saber.

Pero el lado oscuro es real. Cuanto más se adaptan estos sistemas, más fácil resulta rendirse.

La ilusión de la independencia: cuando la personalización se vuelve pasiva

La autonomía en el aprendizaje no se define por la ausencia de ayuda, sino por la presencia de agencia. Ahí es donde la cosa se complica con los tutores de IA.

Lo que comienza como una herramienta de empoderamiento puede convertirse rápidamente en una muleta. A medida que los estudiantes se acostumbran a la infinita paciencia y la retroalimentación inmediata de la IA, comienza una sutil erosión. Hacen menos preguntas aclaratorias. Dependen menos de la memoria. Dejan de adivinar. Con el tiempo, la fricción que antes indicaba una profunda interacción cognitiva se convierte en una superficie suavizada por la conveniencia.

Esto no es hipotético. Estudios recientes muestran un patrón claro: cuando las herramientas de IA se utilizan como sustitutos del pensamiento, en lugar de como andamiajes, las habilidades de pensamiento crítico se estancan o incluso retroceden. El sistema cognitivo, como cualquier sistema, se adapta a una carga reducida. Si se descarga lo suficiente, deja de trabajar por completo.

Y, sin embargo, el problema no es la IA en sí. El problema es el marco instruccional. La misma tecnología que permite atajos también puede facilitar un crecimiento estructurado, si se diseña e implementa teniendo en cuenta el desarrollo cognitivo.

Tres modos de uso (y mal uso)

- Crecimiento guiadoLa IA actúa como un aliado socrático, incitando la reflexión, sugiriendo alternativas y revelando puntos ciegos. La interacción cognitiva es activa, no externalizada.

- Descarga reactivaLos estudiantes usan la IA para "desbloquearse" sin construir esquemas internos. Útil a corto plazo, neutral a largo plazo.

- Dependencia totalLa IA se convierte en el centro principal de la resolución de problemas. El alumno lee, acepta y avanza. El músculo del pensamiento se atrofia.

El desafío para los educadores y diseñadores de productos no es eliminar la descarga, sino hacerla estratégica, deliberada y, en última instancia, innecesaria.

El peligro de la retirada prematura de andamios

La metáfora que suelen usar los educadores es la de las ruedas de entrenamiento. Pero con la IA, la analogía es imperfecta. Porque no son ruedas que se quitan, sino que se quitan solas, silenciosamente, a menudo antes de que el alumno esté listo.

En las aulas, los docentes eficaces saben cuándo intervenir y cuándo dar un paso atrás. Interpretan el lenguaje corporal del estudiante, las señales de frustración y los patrones de vacilación. Andamian con cuidado, se reducen gradualmente y recalibran con frecuencia. Con la IA, el proceso es algorítmico. Y muchos sistemas no están diseñados para los matices.

La eliminación prematura del andamiaje, ya sea por parte de un tutor de IA o de un diseño de producto bienintencionado, suele generar una ilusión de independencia: los estudiantes creen haber dominado una habilidad porque el apoyo desaparece. Pero el dominio requiere transferencia. Y la transferencia requiere fricción.

Signos de desvanecimiento prematuro

- Los estudiantes completan tareas pero no pueden explicar su razonamiento.

- El rendimiento disminuye al pasar de entornos estructurados a entornos abiertos.

- La confianza aumenta mientras que la profundidad conceptual sigue siendo superficial.

Sin mecanismos de desvanecimiento calibrados, aquellos que adaptan el apoyo dinámicamente en función de la preparación en lugar de la velocidad, los tutores de IA corren el riesgo de crear estudiantes frágiles. Rápidos en el rendimiento, lentos en la adaptación. Confiados en el sistema, pero no en sí mismos.

Tutores humanos, granularidad emocional y la capa no verbal

Hay otro eje de preocupación que es más difícil de cuantificar: el ancho de banda emocional de la enseñanza.

Los tutores humanos no solo explican, sino que también observan. Responden a las microexpresiones, detectan la confusión antes de que se verbalice y ofrecen ánimo justo cuando se siente la derrota. Esta granularidad emocional es casi imposible de replicar en los sistemas de IA actuales, que se basan en la entrada de texto y la retroalimentación del usuario.

Varios educadores en Reddit hablaron sobre este punto. Uno escribió: «Muchos de mis alumnos acuden a mí frustrados y derrotados, y las explicaciones robóticas no son lo único que necesitan. También necesitan ánimo humano y positividad». Otro añadió: «¿Por qué un alumno escucharía a una IA? Ya están desconectados. ¿Ahora les estás dando otra pantalla?».

Estas preocupaciones no son tecnofóbicas. Son recordatorios de que la instrucción es interpersonal, no solo informativa. La calibración emocional, la presencia en el aula e incluso el silencio compartido forman parte del entorno de aprendizaje al que los tutores de IA aún no han llegado.

Pero tal vez no sea necesario. Tal vez la respuesta no sea forzar a la IA a asumir roles emocionales que no puede cumplir, sino diseñar ecosistemas humanos-IA donde el trabajo emocional siga siendo humano y el trabajo cognitivo sea compartido.

Descarga cognitiva y la ilusión de dominio

La descarga cognitiva no es nueva. Descargamos calculadoras, mapas y correctores ortográficos. Pero la profundidad y la omnipresencia de la descarga de IA no tienen precedentes, especialmente en contextos de aprendizaje.

Investigaciones recientes revelan una paradoja. Los estudiantes que utilizan herramientas de IA suelen mostrar un deterioro en su capacidad de pensamiento crítico con el tiempo, especialmente cuando las herramientas se utilizan como sustitutos en lugar de como apoyo. Esto es especialmente cierto en el caso de los usuarios más jóvenes y aquellos en las primeras etapas de adquisición de habilidades.

Pero aquí está el truco: cuando se utiliza la IA para descargar tareas de nivel inferior, como resumen, formato y estructuración de vocabulario, puede... mejorar Pensamiento de orden superior. En experimentos de redacción de ensayos estructurados, los estudiantes que utilizaron IA generativa para apoyar la ideación y la organización del esquema mostraron resultados de pensamiento crítico más sólidos que quienes no la utilizaron. ¿Por qué? Porque la herramienta les permitió centrar su energía cognitiva en la síntesis, la argumentación y los matices, en lugar de en la mecánica.

La diferencia clave es la intencionalidad.

- Descarga pasiva reemplaza el proceso de pensamiento.

- Descarga activa Favorece un pensamiento más profundo liberando ancho de banda mental.

Esta distinción debería guiar el diseño de productos. Debemos preguntarnos no solo qué tareas realiza un sistema de IA, sino ¿Qué músculos mentales se atrofian o fortalecen en el proceso?.

Diseñar para la retención, no solo para la finalización

Gran parte de la educación actual impulsada por IA se basa en la velocidad: respuestas más rápidas, puntuaciones más altas, mayor rendimiento. Pero la ciencia educativa nos dice que La fluidez no es lo mismo que el dominio, y La finalización no es igual a la retención.

Para evitar que los usuarios se vuelvan dependientes, las herramientas de IA deben diseñarse en torno a:

- Protocolos de desvanecimiento adaptativo:Apoyo que se retira sólo después de evidenciarse la transferencia conceptual.

- Andamios transparentes:Sistemas que muestran a los estudiantes lo que se está estructurando, para que puedan realizar un seguimiento de su propia dependencia.

- Indicaciones metacognitivas:Recordatorios que impulsan a los usuarios a reflexionar, reformular o reconstruir, en lugar de simplemente aceptar.

La dependencia surge cuando los estudiantes confunden el desempeño con la comprensión. La independencia, en cambio, no se basa únicamente en la autonomía, sino en... conciencia, conciencia de lo que uno sabe, en qué confía y cuando el apoyo está moldeando silenciosamente el resultado.

Por eso, el verdadero riesgo educativo de la IA no es hacer trampa, sino olvidar lo que se siente al pensar.

El umbral de la lucha productiva

Toda experiencia de aprendizaje eficaz se mueve en una delgada línea entre la facilidad y el esfuerzo. Demasiada dificultad provoca frustración, desapego o fracaso. Demasiada dificultad fomenta la complacencia y la comprensión superficial.

Este espacio, que los psicólogos educativos llaman la "Zona de Desarrollo Próximo", es donde reside la lucha productiva. Y el arte de la buena enseñanza reside en mantener a los alumnos en esa zona el tiempo suficiente para que desarrollen resiliencia, no solo la capacidad de recordar.

Los tutores de IA suelen colapsar esa zona. Al responder preguntas al instante, resolver ambigüedades o proporcionar ejemplos pulidos a demanda, eliminan el tiempo de preparación que conduce a la comprensión. Sustituyen el proceso por el producto.

Y, sin embargo, en algunos casos, esto puede ser un regalo, especialmente para estudiantes que históricamente han sido excluidos de la educación de élite o carecían de acceso a ayuda personalizada. Para quienes compaginan múltiples trabajos, barreras lingüísticas o traumas, las respuestas rápidas y fiables pueden ser un salvavidas.

El desafío ético, entonces, no es limitar la generosidad de la IA, sino rediseñar su lógica de interacción. Debemos construir fricción en la interfaz, diseñando deliberadamente pausas, puntos de reflexión o pautas de recuperación.

Consideremos estos ejemplos:

- En lugar de dar una respuesta inmediata, la IA pregunta al usuario qué ha intentado hasta ahora.

- Antes de presentar una definición, la herramienta solicita una hipótesis generada por el usuario.

- Después de un ejemplo trabajado, se requiere que el alumno lo adapte a un contexto diferente.

Estas no son limitaciones técnicas. Son decisiones pedagógicas.

Necesitamos sistemas de IA que no sólo sean eficientes, sino inteligente desde el punto de vista del desarrollo, herramientas que entienden cuándo ayudar, cuándo frenar y cuándo dejar que el alumno luche con el peso de un problema.

Hay una diferencia entre eficiencia y desarrollo. Uno optimiza la velocidad y el otro la fuerza.

La IA hace que el aprendizaje sea más eficiente, con acceso más rápido a las respuestas, explicaciones más claras y reintentos sin límites sin juicios. Pero la eficiencia por sí sola no desarrolla la capacidad intelectual. Al igual que usar un GPS en cada viaje puede debilitar nuestro sentido de la orientación, usar la IA para abreviar cada pregunta puede reducir nuestra capacidad para lidiar con la ambigüedad, la confusión y la incomodidad productiva que requiere el verdadero aprendizaje.

Lo peligroso es la sutilidad de esta erosión. Las herramientas de IA están diseñadas para parecer mágicas, sencillas, fluidas y fáciles de usar. Pero en su amabilidad, pueden eliminar la fricción que a menudo requiere el aprendizaje..

Y la fricción no es un fracaso.

La fricción es donde el reconocimiento de patrones se convierte en razonamiento.

La fricción es el punto donde un giro equivocado genera una nueva perspectiva.

La fricción es donde se construye la memoria, no sólo se descarga información.

Cuando los estudiantes externalizan esa fricción por completo a la IA, pierden el acceso a los procesos que hacen que el conocimiento sea duradero y transferible. Una respuesta correcta dada demasiado pronto cortocircuita el proceso de construcción. Sin la lucha, el estudiante no sólo pierde el desafío, pierde propiedad.

Así que la tarea no es eliminar la fricción. La tarea es... Diséñalo sabiamente¿Cómo lo hacemos?

- Utilice la IA para ampliar las ideas, no para sustituir el pensamiento.

- Deje que la IA le ofrezca opciones, no conclusiones.

- Fomente la exploración con preguntas del tipo “¿qué pasaría si…?” antes de dar las respuestas finales.

- Haz espacio para la reflexión: ¿Por qué la IA sugirió esto? ¿Qué habría hecho diferente?

Estas no son restricciones, sino invitaciones. Invitaciones a reducir el ritmo lo justo para que el aprendizaje se arraigue. Porque sin esa pausa, ese procesamiento, esa tensión, no conseguimos estudiantes. Conseguimos operadores.

Cuando el apoyo se convierte en un techo

Está surgiendo una paradoja en el aprendizaje mediado por IA: cuanto mejor funciona la herramienta, más invisible se vuelve el límite entre apoyo y sustitución.

Al principio, los tutores de IA actúan como rueditas de entrenamiento: guían a los estudiantes, reducen la fricción y ofrecen empujoncitos oportunos. Pero sin un diseño cuidadoso, estos apoyos se convierten en límites. Limitan la exploración. Acortan la dificultad. Susurran las respuestas antes de que el alumno tenga tiempo de lidiar con la pregunta.

Este no es un problema nuevo. En psicología cognitiva, se define como: El efecto de inversión de la experienciaLo que beneficia a un principiante puede obstaculizar a un futuro experto. El exceso de andamiaje impide una mayor implicación cognitiva, especialmente a medida que los estudiantes adquieren mayor capacidad.

Y no se trata solo de una dependencia excesiva. Se trata de la amable Estamos diseñando el aprendizaje. Hay una diferencia entre: Descarga cognitiva que libera la memoria de trabajo para que los estudiantes puedan centrarse en la comprensión contra Subcontratación cognitiva que desplaza el pensamiento por completo.

No queremos estudiantes que puedan encontrar respuestas. Queremos estudiantes que sepan. Qué hacer cuando no saben qué hacer.

Y, sin embargo, muchos sistemas de IA priorizan la fluidez sobre la reflexión. Están optimizados para la velocidad, no para la dificultad. Para completar, no para comprender.

Por eso el andamiaje calibrado, el arte de saber cuándo... desteñir El apoyo no es un detalle de la experiencia de usuario (UX). Es un imperativo pedagógico. Sin él, corremos el riesgo de formar una generación de estudiantes que se sienten eficientes, pero carecen de la profundidad, la resiliencia y la autonomía que exige la verdadera educación.

El futuro docente: de arquitecto de la información a ético cognitivo

En la era de la educación mediada por IA, el rol del docente no se ve disminuido, sino redefinido. Si bien antes el docente era la principal fuente de información, hoy es el arquitecto de la experiencia. Su dominio ya no reside en la entrega de contenido, sino en la calibración cognitiva: saber cuándo explicar, cuándo cuestionar, cuándo hacer una pausa y cuándo dejar que el alumno se siente inseguro. Si la IA es el andamiaje, el docente es quien decide cómo se ensambla, cuándo se ajusta y cuándo se retira.

Este cambio exige un nuevo tipo de fluidez. No solo en herramientas, sino también en las compensaciones. No solo en plataformas, sino también en pedagogía. Los docentes ahora deben comprender:

- Cuando la personalización se convierte en pasividad.

- Cuando la descarga socava el desarrollo.

- Cuando el apoyo se convierte en un techo y no en un trampolín.

Más que nunca, el educador es un diseñador de umbrales: construye suficiente apoyo para prevenir el colapso, pero también suficiente espacio para cultivar la resiliencia. Y tras todo esto subyace un mandato ético. Porque cuanto más invisible se vuelve la IA, más poderosa es su influencia. No solo moldea lo que hacen los estudiantes, sino también su forma de pensar y, finalmente, en quiénes se convierten.

Así que debemos hacer preguntas difíciles

¿Quién decide cuándo se desvanece el cadalso?

¿Quién garantiza que la fricción no se superponga en favor de la fluidez?

¿Quién observa la lenta erosión de la autonomía intelectual detrás del brillo de una experiencia de usuario perfecta?

La respuesta, todavía, debe ser el maestro humano.

No porque la IA no sea poderosa.

Pero porque el desarrollo humano requiere discernimiento, sintonía y cuidado.

Y ninguna interfaz, por inteligente que sea, puede enseñar aún lo que significa pensar por uno mismo.

Conclusión: Diseñar inteligencia, no solo interfaces

A lo largo de este ensayo, hemos analizado cómo la personalización sin pedagogía genera dependencia, cómo la descarga puede ser beneficiosa o perjudicial según el diseño, y cómo la fricción, en lugar de la fluidez, es la base del aprendizaje real. Sin embargo, quedan algunos hilos sin resolver.

Hemos visto cómo la autonomía difiere de la independencia, pero ¿cómo se ve realmente el desvanecimiento calibrado en la práctica? Hemos reconocido los límites emocionales de la IA, pero ¿qué papel deberían desempeñar los educadores humanos en esta nueva ecología cognitiva? Y, lo más importante: ¿cuál es la responsabilidad ética de quienes diseñan los andamiajes que configuran no solo los resultados del aprendizaje, sino también a los propios estudiantes?

Terminemos mirando hacia adelante, no a la tecnología, sino a las intenciones que codificamos en ella.

No solo estamos diseñando mejores tutores de IA.

Estamos diseñando los hábitos de los pensadores del futuro.

Estamos moldeando cómo se construye la resiliencia, cómo se mantiene la confusión, cómo se gana el dominio, no cómo se entrega.

Y eso significa reducir la velocidad cuando todo quiere ir más rápido.

Detenerse donde la fricción revela conocimiento. Elegir no la interfaz más inteligente, sino la que forja las mentes más brillantes.

Porque al final, el futuro de la educación no estará determinado por la rapidez con la que podamos enseñar a las máquinas a enseñarnos, sino por el cuidado con el que protejamos las condiciones que permiten a los humanos aprender.

Estas son las soluciones que Infinite Stair puede ayudarte a construir

Si eres una universidad, una empresa de tecnología educativa, una plataforma MOOC o un diseñador de LMS, estas no son solo ideas, sino prototipos a punto de hacerse realidad. Aquí es donde podemos colaborar contigo para convertir la teoría en transformación:

- Implementar protocolos de desvanecimiento calibrado: Desarrollar tutores de IA que no solo apoyen a los estudiantes sin cesar, sino que también sepan cuándo dar un paso atrás, utilizando señales adaptativas de preparación para retirar el andamiaje sin comprometer la profundidad.

- Incorpore un andamiaje metacognitivo en cada interacción: Diseñe flujos de aprendizaje que impulsen a los estudiantes a reflexionar, predecir o explicar antes de recibir ayuda, cultivando la conciencia en lugar de la finalización pasiva.

- Diseñar interfaces sensibles a la fricción: Introduzca pausas intencionales en los ciclos de retroalimentación de la IA para impulsar la generación, comparación o recuperación de hipótesis, manteniendo vivo el esfuerzo cognitivo en momentos clave.

- Seguimiento de la descarga cognitiva y alertas de dependencia: Construir interfaces que midan y visualicen la dependencia de los estudiantes de la asistencia de IA, haciendo visible la dependencia para que pueda abordarse, no ignorarse.

- Desarrollar vías de aprendizaje dual: con apoyo de IA vs. con IA mínima: Ofrecer a los estudiantes la opción de elegir su nivel de apoyo y empoderar a los instructores para comparar los resultados en términos de retención, resiliencia y razonamiento.

- Cree paneles de control para instructores que decodifiquen el pensamiento: Vaya más allá de la corrección hacia la comprensión, mostrando no sólo si los estudiantes hicieron lo correcto, sino cómo Llegaron allí y dependieron demasiado de la automatización.

- Rediseño de la capacitación docente para aulas mejoradas con IA: Ayudar a los educadores a adaptarse a su rol cambiante como facilitadores de la autonomía cognitiva, capacitándolos para saber cuándo guiar, cuándo dejar ir y cómo interpretar patrones de aprendizaje aumentados por IA.

- Prueba de retención, no solo de finalización: Redefinir las métricas de éxito para incluir la transferencia, la recuperación retrasada y la formulación de estrategias, no solo la finalización de tareas o las ganancias a corto plazo.

- Establecer valores éticos predeterminados para una IA que promueva la autonomía: Construir sistemas que favorezcan la exploración por sobre el solucionismo, la transparencia por sobre la opacidad y un andamiaje que los estudiantes eventualmente puedan desmantelar por sí solos.

- Integrar el aprendizaje de las ciencias desde el día cero: Colabore con científicos cognitivos y expertos pedagógicos desde el comienzo del proceso de diseño, para que su plataforma se alinee con la forma en que las personas interactúan. de hecho aprenden, no sólo la rapidez con la que hacen clic.

Éstos son los sistemas que vale la pena construir.

Éste es el futuro que queremos diseñar.

Si estás listo, reserva una cita con Infinite Stair.

Referencias

- Sajja, R., Sermet, Y., Cikmaz, M., Cwiertny, D. y Demir, I. (2023). Asistente inteligente basado en inteligencia artificial para el aprendizaje personalizado y adaptativo en la educación superior. arXiv. https://arxiv.org/abs/2309.10892

- Chen, L., Chen, P. y Lin, Z. (2020). Inteligencia artificial en educación: una revisión. Acceso IEEE. https://ieeexplore.ieee.org/document/9099040

- Nguyen, A., Ngo, HN, Hong, Y., Dang, B. y Nguyen, BT (2023). Principios éticos para la inteligencia artificial en la educación. Educación y tecnologías de la información. https://link.springer.com/article/10.1007/s10639-023-11567-1

- Eynon, R. y Young, E. (2021). Metodología, leyenda y retórica: Las construcciones de IA por parte de la academia, la industria y grupos de políticas para el aprendizaje permanente. Ciencia, tecnología y valores humanos. https://journals.sagepub.com/doi/10.1177/0162243921992826

- Selwyn, N. (2022). El futuro de la IA y la educación: algunas advertencias. Revista Europea de Educación. https://onlinelibrary.wiley.com/doi/10.1111/ejed.12465

- Azeem, S., y Abbas, M. (2025). Correlatos de personalidad del uso académico de la inteligencia artificial generativa y sus resultados: ¿Importa la equidad? Tecnologías de la educación y la información. https://link.springer.com/article/10.1007/s10639-024-11891-2

- Cotton, D., Cotton, P. y Shipway, R. (2023). Chat y trampas: Garantizando la integridad académica en la era del chat. GPT. Innovaciones en educación y enseñanza internacional. https://www.tandfonline.com/doi/full/10.1080/14703297.2023.2235160

- Ouyang, F., y Jiao, P. (2021). Inteligencia artificial en educación: Los tres paradigmas. Informática y educación: Inteligencia artificial. https://www.sciencedirect.com/science/article/pii/S2666920X21000030

- Zawacki-Richter, O., Marín, VI, Bond, M. y Gouverneur, F. (2019). Revisión sistemática de la investigación sobre aplicaciones de inteligencia artificial en la educación superior: ¿Dónde están los educadores? Revista Internacional de Tecnología Educativa en la Educación Superior. https://link.springer.com/article/10.1186/s41239-019-0171-0

- Xu, W., y Ouyang, F. (2022). La aplicación de tecnologías de IA en la educación STEM: una revisión sistemática de 2011 a 2021. Revista Internacional de Educación STEM. https://stemeducationjournal.springeropen.com/articles/10.1186/s40594-022-00346-1

- Li, Y., Song, R. y Yang, H. (2025). El impacto del uso de herramientas de IA en las habilidades de pensamiento crítico de los estudiantes: Descarga cognitiva y resultados de aprendizaje. Semantic Scholar. https://www.semanticscholar.org/paper/cce6e863d5408244284d97f5a13e8c9ab103ad01

- Johnson, A., y Moore, T. (2024). Fatiga de diseño y externalización cognitiva en industrias creativas. Preimpresión de arXiv. https://arxiv.org/abs/2503.03924

- Zhang, K. y Liu, M. (2024). ChatGPT en la educación médica: Un estudio de métodos mixtos sobre percepciones y resultados del pensamiento crítico. PubMed. https://pubmed.ncbi.nlm.nih.gov/39150341/

- Choi, J. (2023). La instrucción de descarga cognitiva basada en IA generativa mejora el pensamiento crítico en la redacción de ensayos. Semantic Scholar. https://www.semanticscholar.org/paper/433196bdfd94b207f666959860d68fa5228cf06f

- Huang, X., et al. (2023). Escritura académica asistida por IA y metacognición estudiantil. Semantic Scholar. https://www.semanticscholar.org/paper/209486f169615029c3d9df7d8c3c9f3af8670500

- Wang, L. y Li, Q. (2024). Un estudio comparativo sobre pensamiento crítico: ChatGPT vs. estudiantes humanos que utilizan CCTST. Semantic Scholar. https://www.semanticscholar.org/paper/dc82757a6bfad873c9d928e8521cd4a11d534918

- Sihombing, T., y Rachmadtullah, R. (2024). Herramientas de IA y razonamiento matemático: ¿Ayuda o obstáculo? Semantic Scholar. https://www.semanticscholar.org/paper/cb74c058802eccfe0e480c85806bb929d6964dda

- Liu, Y., et al. (2023). Metaanálisis sobre el impacto del aprendizaje potenciado por la tecnología en los resultados de los estudiantes de educación superior. Semantic Scholar. https://www.semanticscholar.org/paper/9763d08a798b06928f541606461f6a9d521ca36b

- Park, H. y Lee, J. (2023). Aprendizaje basado en juegos en la primera infancia y sus efectos cognitivos. PubMed Central. https://www.ncbi.nlm.nih.gov/pmc/articles/PMC11018941/

- Kim, E. (2024). El efecto de las estrategias cognitivo-conductuales en la educación científica. Semantic Scholar. https://www.semanticscholar.org/paper/f52de212742e0b3afecf44fda19371a9a941ddf6